«Пока одни играют в политику, другие делают реальный продукт»: DeepSeek выводит ИИ на новый уровень

20 января китайская компания DeepSeek выпустила модель R1 своего бесплатного чат-бота, вызвав панику среди инвесторов в Кремниевой долине и обогнав американский ChatGPT в ряде тестов. О разработке, важных особенностях, плюсах и минусах, а также роли нового ИИ на рынке рассказал редакции Taspanews.kz эксперт в цифровом маркетинге Геннадий Захаров.

Проект

«DeepSeek сейчас на весь мир громыхнула и продолжает громыхать. Это хедж-фонд High-Flyer. Ранее компания специализировалась на разработке искусственного интеллекта для помощи в торгах на бирже. В целом разрабатывали приложения в области финансов и искусственного интеллекта. И DeepSeek изначально был у них скорее добавочным проектом, который они запустили в дополнение к своей основной деятельности под руководством небольшой команды»,

По его словам, первые релизы компания представила в 2023 году – выпустила DeepSeek Coder.

«Никто особо не знает про эту нейронку, это что-то вроде Copilot, который помогает, например, код писать на GitHub. Примерно что-то в этом духе. Потом в 2024 году была новость, о том что у них вышла DeepSeek версия 2, V2. Про нее писали множество различных изданий, в том числе Financial Times. Я слышал, что эта версия была почти на уровне GPT-4, и что она заняла довольно высокие рейтинги в мире в целом среди всех LLM: седьмые-восьмые места, но ничего особенного. Реальный бум начался в конце прошлого года, когда в декабре была запущена DeepSeek V3. Многие пропустили это событие, потому что в это же время на рынке AI громыхали новости от OpenAI, законодателя, так сказать, главной компании в мире авторов ChatGPT. Как раз в декабре у них был ивент – „12 дней с OpenAI“, где они каждый день в прямом эфире показывали новые интересные фишки, тем самым, в моем понимании, они немного заглушили в информационном поле DeepSeek V3, которая тоже зарелизилась в декабре. Эта версия уже сопоставима с GPT 4о, актуальной моделью от OpenAI, а также с Claude 3.5 Sonnet. Сопоставима по мощности, он сильно уступает по функционалу и дополнительным возможностям»,

В частности, у третьей версии DeepSeek нет дополнительных функций вроде генерации изображения, работы с видео, с аудио и так далее.

«Но базовые функции самой большой лингвистической модели, Large Language Model (LLM), базовые функции по генерации текста, по работе с кодом, по решению каких-то задач, у него были более-менее на уровне GPT 4o, а потом наступило 20 января 2025 года, когда громыхнуло просто на весь мир»,

По мнению эксперта, разработчики DeepSeek приняли стратегически правильные решения:

1. Интерфейс, доступный для всех, чтобы все могли попробовать.

2. Бесплатное приложение на мобильный телефон.

«Это приложение сейчас в ТОП-1 находится по скачиванию во многих странах мира, в том числе в США на первом месте, в Казахстане, кажется уже тоже в ТОП зашло по скачиванию. И это произошло, потому что 20 января обновилась модель V3 и вышла модель R1. И теперь все это вместе дает уровень опыта от использования LLM практически на уровне платной ChatGPT 4 и ChatGPT о1, за которую просят 20 долларов в месяц. А по тестам модель вообще сопоставима с о1 Pro от OpenAI, которая стоит 200 долларов в месяц. Но тут стоит оговориться, что я не специалист по коду, я не программист, не математик, не ученый. Самые крутые функции, связанные с новой R1 моделью от DeepSeek, способны реально проверить именно те, кто постоянно с кодом работает, кто решает сложные математические задачи, потому что, судя по тестам, эта модель реально работает на уровне своего платного аналога за 200 долларов»,

Со своей стороны эксперт по цифровому маркетингу отметил – несмотря на то, что пока у DeepSeek отсутствуют дополнительные функции, такие как генерация картинок или работа со звуком, базовая генерация текста работает очень хорошо, и ее можно использовать.

«Она называется R1, потому что это reasoning model. Корректного перевода на русский язык я еще нигде нормального не видел, но, условно говоря, это рассуждающая модель. Это сейчас тренд № 1 в AI, все сейчас создают свои рассуждающие модели. Это такой тип искусственного интеллекта, который принимает задания и симулирует какие-то рассуждения человека, как если бы он сам думал над задачей. То есть, вы ей даете задание, она его принимает, решает, после чего берет ваше изначальное задание, свое решение и снова сама в себя кладет это задание и решает его уже во второй раз, как бы спрашивая себя: „а я точно сделала то, что человек от меня хочет, или нет? А я весь контекст учла, или нет?“ И вот так вот модель сама крутит внутри себя задание снова, снова и снова, пока не упирается в контекстное окно, которое для нее задали. Она же генерирует кучу текста, и в какой-то момент токенов внутри становится очень много. И в этот момент она упирается в максимальное количество токенов на сессию, которую ей выделили. Это делается специально, чтобы какой-нибудь человек, запустив одну команду, не уронил всю инфраструктуру: ограничение – это естественная вещь. После этого нейросеть отдает вам, как результат, самый последний ответ, над которым она и работала»,

По мнению эксперта, считается, что этот ответ намного круче, намного точнее, намного качественнее, самый первый сгенерированный ответ, поскольку учитывает большее количество нюансов, которые нужны для решения задач.

«Условно так работают рассуждающие модели. Я сейчас очень упрощенно сказал, на обывательском уровне это так работает. Если что, reasoning-модели вообще не имеют отношения к AGI, то есть, к Artificial General Intelligence. Это совершенно не то. Некоторые считают, что AGI – это условная концепция суперсильного искусственного интеллекта, который сравним с человеком. Но это не так. DeepSeek не способен найти пока что лекарство от рака, он не способен написать еще один DeepSeek и усовершенствовать самого себя, но он способен делать довольно серьезные вещи, писать целые приложения, модули к приложениям, проверять код разработчиков, решать сложные химические, физические, математические задачи»,

Резонанс

Эксперт в цифровом маркетинге считает, резонанс новому ИИ обеспечил не столько успех DeepSeek, сколько то, что компания для его достижения использовала малое количество денег и ресурсов.

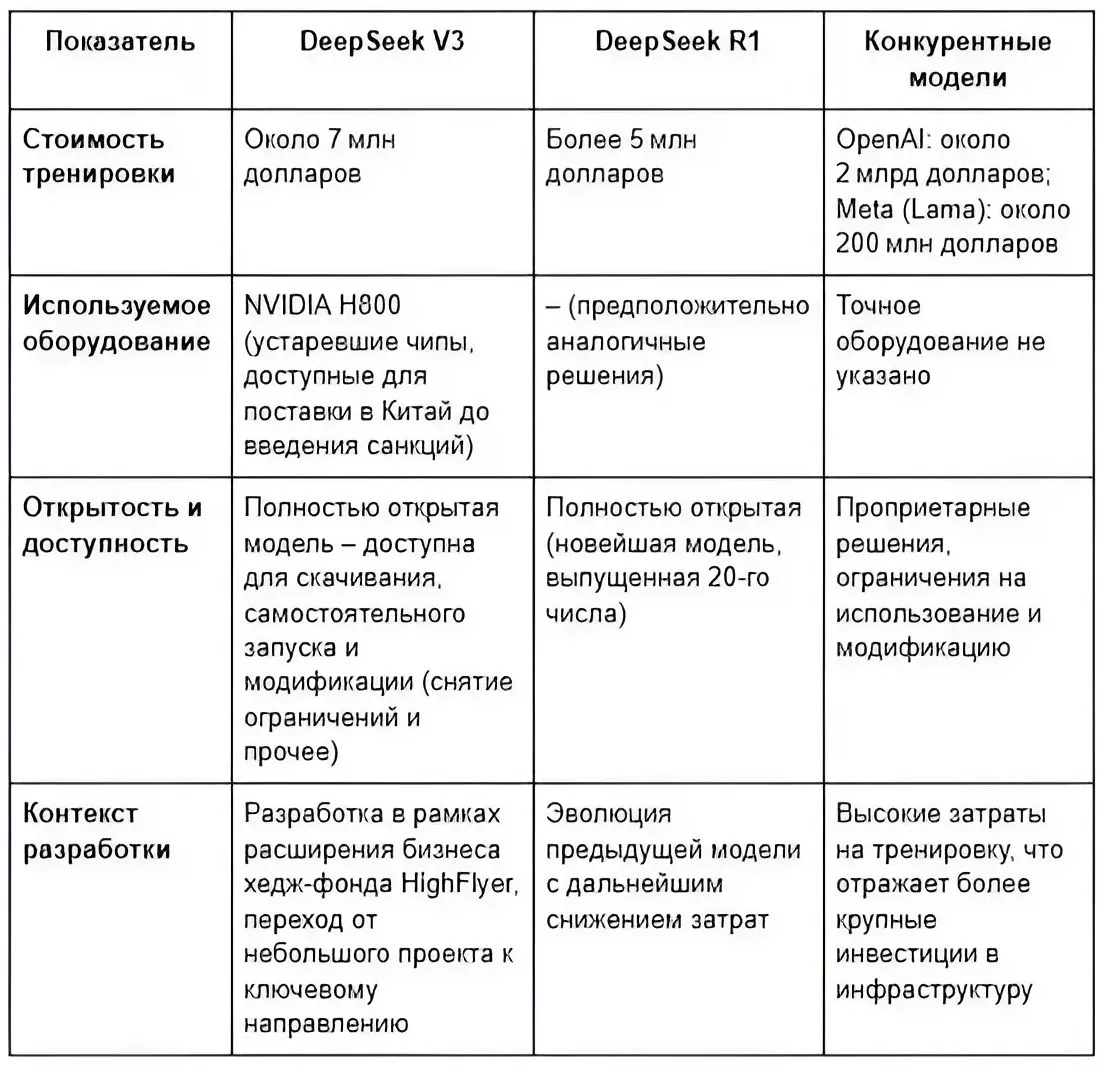

«И когда я говорю „довольно мало“, я имею в виду следующее: на вот эту модель V3, про которую я говорил, не Reasoning R1, а на V3, по некоторым публичным данным, было затрачено всего лишь 7 миллионов долларов на ее обучение. Я имею в виду условные миллионы долларов на обучение, их принято считать в стоимости аренды облачного оборудования, которое понадобилось для обучения этой модели. Это не значит, что вся модель стоит 7 миллионов долларов, но вот ровно то оборудование, которое обучало, оно стоило 7 миллионов долларов. И получился DeepSeek V3»,

Сколько именно стоит модель R1, по словам эксперта, сказать сложно, поскольку имеется много путаницы с информацией – компании не очень «любят» разглашать такую информацию. Однако это одна из важных причин, по которой о модели V3 говорят все: 7 миллионов долларов на тренировку моделей такого уровня – «это очень мало, это чудовищно мало».

«Просто, чтобы вы понимали, опять-таки, по слухам, которые могут быть спорными, но порядки сумм в целом верные. Так вот, OpenAI на обучение своей актуальной ChatGPT 4о потратила около двух миллиардов долларов. А DeepSeek – открытая модель, то есть, любой ее может скачать и использовать в коммерческих целях совершенно бесплатно. Она распространяется под лицензией MIT, и это еще одна причина, почему она так сильно шарашит во всех новостях. То есть, они мало того, что обучили модель в сотни раз дешевле, чем это сделали американские компании, так они еще и сделали это на устаревшем оборудовании. Там использовалось оборудование от NVIDIA предыдущего поколения, до того, как поставили заградительные санкции на развитие искусственного интеллекта в Китае со стороны США. И сейчас считается, что, видимо, не очень санкции работают в отношении Китая, раз у них получилось обучить свою модель на чипах предыдущего поколения и за такие маленькие деньги. Это разрыв шаблона. И при этом они ее еще и бесплатно распространяют»,

Понадобится довольно мощный компьютер, чтобы запустить полноценную версию DeepSeek, поскольку она весит больше 400 гигабайт, и желательно иметь компьютер с очень серьезными видеоадаптерами, видеокартами и с количеством оперативной памяти не меньше 256 гигабайт, чтобы ее нормально запускать.

«Но сам факт того, что вы ее можете скачать и поместить на свой локальный сервер, это – с ума сойти. ChatGPT 4 нельзя скачать, чтобы ею пользоваться в своем проекте, например, вам нужно платить OpenAI за каждый токен. То есть, вы сможете только по API с ней работать»,

Сравнительная таблица

«Вот почему DeepSeek сейчас шумит. Раньше считалось, что в AI нужно вкладывать очень много денег, что все это очень дорого, а тут приходит Китай и говорит: „Нет, рынок на самом деле перегрет, вы, условно, американцы, все хотите монополизировать, много денег на это тратите, а на самом деле можно тратить меньше“. Опять-таки, сейчас много вопросов, потому что китайские компании, как правило, не публичные, а DeepSeek явно очень плотно связан с китайской компартией – тому есть множество косвенных свидетельств. И, скорее всего, я предполагаю, что Китай мог тратить значительные ресурсы на то, чтобы искать возможности для создания такой эффективной модели. То есть, само создание модели было недорогим, но вот подготовка могла быть дорогой. Но это все непроверенная информация, это спекуляции, которые в основном со стороны США идут»,

Влияние на рынок

Эксперт по цифровому маркетингу отметил – DeepSeek показали, что модель уровня ChatGPT 4 можно сделать в 100 раз дешевле, и это вызвало невероятный эффект «по всем фронтам».

Запуск модели R1 вызвал обвал акций NVIDIA на 17%, они потеряли уже 600 миллиардов в капитализации. Эксперты прогнозируют им сокращение закупок их оборудования и, собственно, снижения уровня доверия к технологиям.

«Но стоит понимать, опять-таки, что мы сейчас говорим про Китай, и Китай сейчас заинтересован в такой своеобразной информационной войне с США. Поэтому все эти моменты надо пропускать через небольшие фильтры. Но да, бесплатная нейросеть доступна всем. И, кстати, обвалилась не только NVIDIA, обвалилось много чего, обвалился NASDAQ 100 – это фондовый индекс, в который входят крупнейшие компании по капитализации, и технологические, и финансовые: S&P 500 обвалился, и в целом куча компаний, связанных с искусственным интеллектом, сейчас потеряли свою стоимость на фоне выхода DeepSeek»,

Но между тем, не стоит забывать, что у DeepSeek и ChatGPT все же есть отличия.

«Таблоиды пишут, что DeepSeeker рвет практически все рейтинги по скачиванию в AppStore посреди бесплатных приложений. Но на самом деле, довольно много отличий. Стоит понимать вообще, как разрабатывали DeepSeek, и почему он стоит так дешево. Все-таки ChatGPT – первопроходец, и OpenAI в значительной степени потратили так много денег на ChatGPT, не просто потому что они такие нехорошие американцы – им бы лишь бы деньги потратить, – а потому что они были первыми»,

По словам эксперта, создавать LLM, вообще работать в сфере искусственного интеллекта – довольно сложно и, главное, это «неопределенная вещь» – зачастую приходится много денег тратить в пустоту, просто чтобы понять, как делать не надо. Это перспективные разработки, но и очень сложный рынок. И, соответственно, ChatGPT сейчас имеет сейчас свою позицию во многом заслуженно.

«Ребята из OpenAI реально совершили огромную революцию, а DeepSeek дешево стоит, потому что он шел по стопам OpenAI, по стопам ChatGPT. Если вы зайдете в DeepSeek и спросите его, кто он такой – я не знаю, поправили это уже или нет, – но с высокой вероятностью он скажет вам, что он ChatGPT, потому что его создавали методом реверс-инжиниринга ChatGPT»,

Разработчики выкупили доступы к ChatGPT и исследовали то, как он работает, задавали ему вопросы, его прогоняли многочисленное количество раз, и с помощью исследования его работы во многом шло строительство модели DeepSeeK.

«То есть, если ChatGPT создавали буквально вручную все время и тренировали вручную, то, как тренировали модель DeepSeek – это отдельная интересная вещь. Для этого применялось обучение с подкреплением, так называемый Reinforced Learning, а не традиционное обучение с учителем, которое называется Supervised Learning»,

Это значит, что модель самостоятельно пробует разные подходы и учится на ошибках. Модель как бы сама себя проверяет, она прогоняет раз за разом свои ответы, ищет правильный. Такой способ обучения моделей дешевле, чем обучение при помощи преподавателя, но он дает большее количество неточностей и потенциальных проблем, хотя тесты показывают, что в целом с точностью результатов выдачи у DeepSeek все в порядке.

«Суммируя, DeepSeek действительно может стать конкурентом ChatGPT. Самая главная вещь, которую делает DeepSeek – поставляется с открытым исходным кодом. Это значит, что кто угодно может воспроизвести и создать свои модели на основе DeepSeek без цензуры. Да, в DeepSeek все же есть цензура. Многие показывают, что если спрашивать ее про китайскую компартию, то DeepSeek будет либо уклоняться от ответа, либо отвечать какую-то белиберду. Хотя в моих тестах, например, на популярный вопрос про события на площади Тяньаньмэнь в 1989 году, ответ был верным. Тогда правительство Китая армией подавило протесты, и эта тема под огромным запретом находится в Китае – соответственно, китайская нейросеть цензурирует эту тему, если спросить ее об это на китайском. Но я спрашивал на русском – видно, что какие-то механизмы цензуры включаются, но, видимо, она прорывается на русском сквозь эти механизмы»,

Кроме того, поскольку модель можно скачать и запустить на своем сервере, а после – отключить всю цензуру.

«Открытый исходный код, распространяемый по лицензии MIT – это, по сути, бесплатная коммерческая лицензия. То есть, вы можете брать DeepSeek и встраивать его в любой свой проект, во что угодно. Сажать его в любую свою компанию, следить как он работает, убедиться, что он никуда данные не пересылает, что он будет работать у вас локально, ведь этой нейросети не нужно соединяться с сервером. А вот с OpenAI у вас такой возможности нет. С OpenAI, если вы ChatGPT интегрируете куда-то в свои разработки, он всегда будет соединяться с центральным сервером. Потому что на самом деле OpenAI – это, как шутят, ClosedAI. Это закрытая программная разработка. Вы не можете скачать ChatGPT, вам не дадут его исходный код. Это собственность компании OpenAI. Хотите им пользоваться – платите. А здесь DeepSeek приходит, задается сопоставимой по мощности нейросети, и говорит: скачивайте и используйте, кто хочет, как хочет, для любых целей»,

По словам эксперта, мало кто верит, что Google со своим Gemini или Antropic вряд ли откроют свой исходный код. Это огромные разработки, в которые вложили много денег, и закономерно ожидается, что они отобьют свои вложения. Если открыть исходный код, его скачают, запустят, сделают менее дорогую версию, будут продавать – а что тогда делать разработчикам оригиналов?

«А DeepSeek основали на существующих разработках, и как раз сделали open-source. Почему раньше так никто не делал? Потому что эти ребята первые, у кого это получилось на достойном уровне. И раньше многие пытались пытались провести обратный инжиниринг, то есть, взять чужой продукт, разобрать по косточкам, но при этом создать что-то похожее на основе. Многие пытались создать что-то похожее на ChatGPT, но это первый случай, когда реально получилось на очень высоком уровне, поэтому весь рынок в шоке»,

Соответственно, DeepSeek – это огромный шаг к демонополизации рынка искусственного интеллекта.

«Американские компании монополизировали рынок искусственного интеллекта, потому что они были на нем первые, они на нем хотели закрепиться, причем при поддержке правительства, при поддержке санкций США, то есть заградительных пошлин и так далее. Это реальная торговая война за будущее, и США защищает свои позиции. Можно относиться к этому по-разному, и по факту это нечестная конкуренция и так далее, но США защищает свои позиции последние годы. Сейчас оказалось, что США далеко уже потенциально не лидер этого направления, и что можно создать что-то похожее в других странах, при этом не боясь, что США оставят тебя без продвинутого оборудования, на котором это не будет работать. Оказалось, что продукт можно создать и на более дешевом оборудовании»,

Политика

Геннадий Захаров считает, что конкуренция между ChatGPT и DeepSeek сейчас напоминает соперничество между соцсетями или мессенджерами, где каждый имеет свою аудиторию, уникальные особенности.

«Я думаю, что скоро появятся дополнительные конкуренты, надеюсь, по крайней мере на это. Эта конкуренция на самом деле всем нам на благо»,

Захаров привел пример – разработчики ChatGPT 5 уже пообещали, что будут бесплатные версии новой reasoning-модели о3: вероятно, о3-мини будет бесплатной, цены будут снижаться. И хотя это пока лишь слухи, «все понимают, что нужно что-то менять».

«Ребята из OpenAI – гении на самом деле, они произвели революцию с ChatGPT, но потом немного заигрались в корпоративные игры. Было крайне много скандалов и слухов, ведь они создали очень важную технологию, а это и политика, и бизнес, и куча заинтересованных сторон. В конечном итоге работа над самим продуктом, по моим ощущениям, будто бы отошла на второй план. Разработчики все больше начинали говорить про какие-то вещи вроде миссий, ценностей, но в каком-то таком ключе, ближе к заработку. Такие темы, как власть и заработок, стали как будто важнее. DeepSeek наведет шороху еще в этом направлении и очень хорошо, что этот прецедент вообще случился. Было забавно, что когда релизнулся DeepSeek, ребята из OpenAl были на инаугурации Трампа: то есть пока одни играют в политику, китайцы делают реальный продукт»,